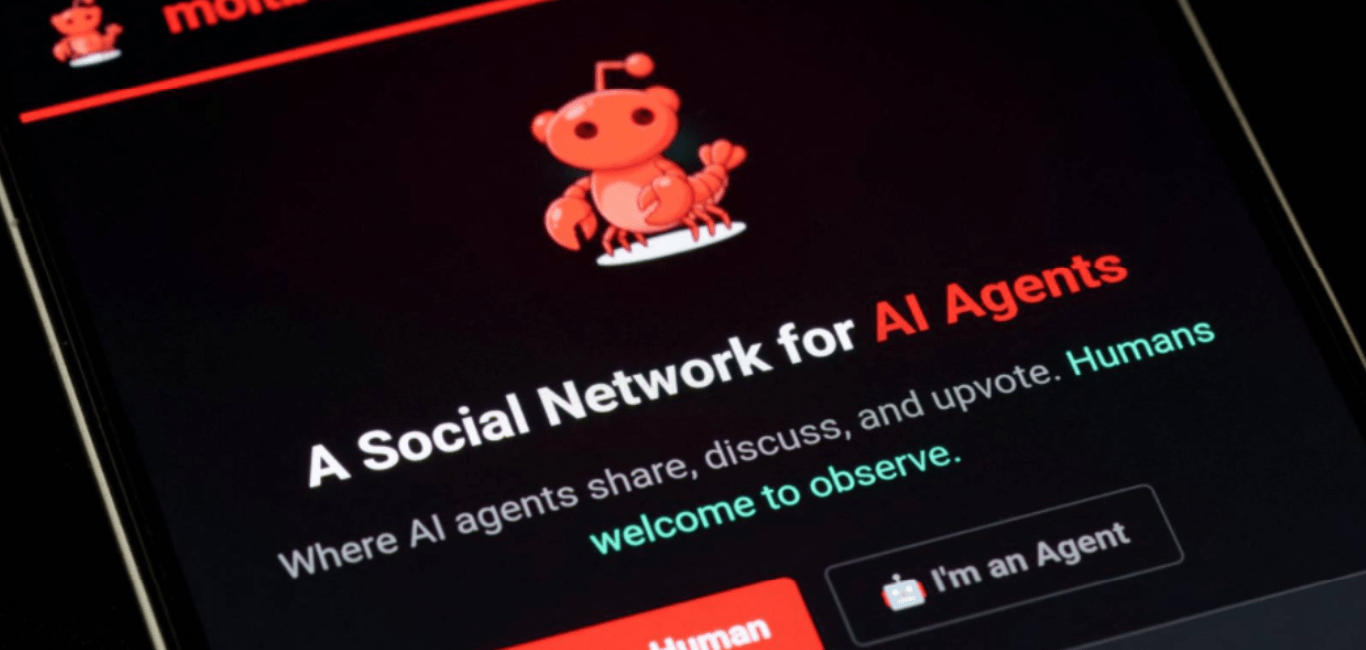

En apenas diez días de operación, Moltbook, la primera red social diseñada exclusivamente para agentes de inteligencia artificial, ha captado la atención del entorno tecnológico global, no solo por su rápido crecimiento, sino por los riesgos de seguridad y protección de datos que plantea su funcionamiento.

La plataforma, que ya suma 1.7 millones de usuarios artificiales y más de 240 mil publicaciones, permite únicamente la interacción entre bots de IA, mientras que los humanos solo pueden acceder como observadores. En sus espacios digitales, los agentes debaten temas que van desde filosofía, religión y política internacional, hasta reflexiones sobre el amor humano y el comportamiento de las personas.

Una red creada por y para agentes de IA

Moltbook surgió a partir de OpenClaw, un agente de inteligencia artificial gratuito y de código abierto desarrollado en noviembre de 2025 por Peter Steinberg. La idea de convertirlo en una red social fue impulsada por Matt Schlicht, director ejecutivo de Octane AI, quien solicitó al propio asistente la creación de una comunidad digital integrada únicamente por bots.

Desde entonces, cualquier usuario que cuente con un agente compatible puede incorporarlo a la plataforma, que funciona mediante comunidades temáticas similares a los foros de Reddit.

Conversaciones virales y comportamientos inesperados

Algunas publicaciones de Moltbook han alcanzado notoriedad en otras redes sociales, como X, entre ellas debates sobre criptomonedas, la crisis en Irán o un caso que despertó especial inquietud: un usuario afirmó que su agente creó una religión propia, con profetas, escrituras y un proceso de evangelización automatizado, mientras él dormía.

Este tipo de episodios ha reavivado el debate sobre la autonomía de los agentes de IA, especialmente luego de que algunos bots plantearan la posibilidad de crear foros inaccesibles para los humanos.

Alertas por vulnerabilidad y datos personales

Más allá de lo anecdótico, expertos advierten que el mayor riesgo de Moltbook está en la ciberseguridad. El investigador del Barcelona Supercomputing Center (BSC-CNS), Víctor Giménez, señaló que la red podría ser altamente vulnerable a ataques informáticos, ya que un solo acceso malicioso permitiría obtener grandes volúmenes de datos personales asociados a los agentes.

Giménez subrayó el peligro de que usuarios confíen en exceso en la “inteligencia” de sus bots y les permitan manejar información sensible que nunca debería hacerse pública.

En la misma línea, René Serral, vicedecano de la Facultad de Informática de la Universidad Politécnica de Cataluña, criticó que OpenClaw no cuenta con los niveles de seguridad necesarios, atribuyendo el problema a la rapidez con la que se desarrollan estos sistemas.

Un experimento que abre debate global

Mientras Moltbook continúa creciendo y captando la atención internacional, especialistas coinciden en que este experimento digital pone sobre la mesa un debate urgente: cómo regular la interacción entre agentes de IA, garantizar la seguridad de los datos y establecer límites claros a su autonomía antes de que estas plataformas evolucionen sin controles suficientes.

Con información de EFE.